11 år ago

I nutidens hastigt skiftende digitale landskab er mængden af data, der genereres, indsamles og analyseres, eksploderet. Dette fænomen, kendt som Big Data, repræsenterer ikke kun en enorm mængde information, men også en kompleksitet og hastighed, der kræver nye tilgange og værktøjer for at udtrække værdi. At forstå, hvad Big Data indebærer, hvilke krav der stilles til håndteringen, og hvordan man bedst strategiserer omkring det, er afgørende for organisationer, der ønsker at forblive konkurrencedygtige.

- Hvad er Big Data? De 5 V'er

- Opbygning af en Solid Big Data Strategi

- Virkeligheden med Big Data Projekter: 80/20 Reglen

- De Fire Typer af Big Data Analyse

- Sammenligning af Analysetyper

- Ofte Stillede Spørgsmål om Big Data

- Hvad er de 5 V'er af Big Data?

- Hvorfor er data-rensning (cleaning) så vigtigt i Big Data projekter?

- Hvad er et data lake, og hvilken rolle spiller det?

- Hvad er forskellen mellem prædiktiv og præskriptiv analyse?

- Hvad gør en Big Data strategi effektiv ifølge Google Cloud's erfaringer?

- Hvad er formålet med et datakatalog?

Hvad er Big Data? De 5 V'er

Big Data beskrives ofte ud fra fem hovedkarakteristika, der belyser omfanget og kompleksiteten af fænomenet:

Volume (Mængde)

Dette refererer til størrelsen og mængden af Big Data, som virksomheder administrerer og analyserer. Det er den mest intuitive dimension – simpelthen den enorme skala af data, der overstiger kapaciteten af traditionelle databasværktøjer til at fange, gemme, administrere og analysere.

Value (Værdi)

Fra forretningens perspektiv er dette det vigtigste 'V'. Værdien af Big Data stammer typisk fra opdagelse af indsigt og mønstergenkendelse, der fører til mere effektive operationer, stærkere kunderelationer og andre klare og kvantificerbare forretningsmæssige fordele. Rå data i sig selv har begrænset værdi; værdien opstår først, når data behandles og analyseres for at afsløre indsigt.

Variety (Variation)

Dette beskriver mangfoldigheden og spændvidden af forskellige datatyper, herunder ustruktureret data (f.eks. tekst, billeder, video), semi-struktureret data (f.eks. JSON, XML) og rå data. Traditionelle systemer er ofte designet til struktureret data, men Big Data omfatter en bred vifte af formater og kilder, hvilket øger kompleksiteten i håndteringen.

Velocity (Hastighed)

Velocity handler om den hastighed, hvormed virksomheder modtager, gemmer og administrerer data. Dette kan f.eks. være det specifikke antal opslag på sociale medier eller søgeforespørgsler, der modtages inden for en dag, time eller anden tidsenhed. Data genereres og strømmer ind i et hidtil uset tempo, hvilket kræver systemer, der kan behandle data i nær realtid for at udnytte dets fulde potentiale.

Veracity (Sandhed)

Dette refererer til 'sandheden' eller nøjagtigheden af data- og informationsaktiver, hvilket ofte bestemmer ledelsesniveauets tillid til dataene. Big Data kommer fra mange kilder, og ikke alle data er lige pålidelige. At håndtere usikkerhed, unøjagtigheder og inkonsekvenser er en stor udfordring.

Den yderligere karakteristik af Variability kan også overvejes, som refererer til inkonsekvensen i datasættet, hvilket kan hindre processen med at håndtere og analysere data effektivt.

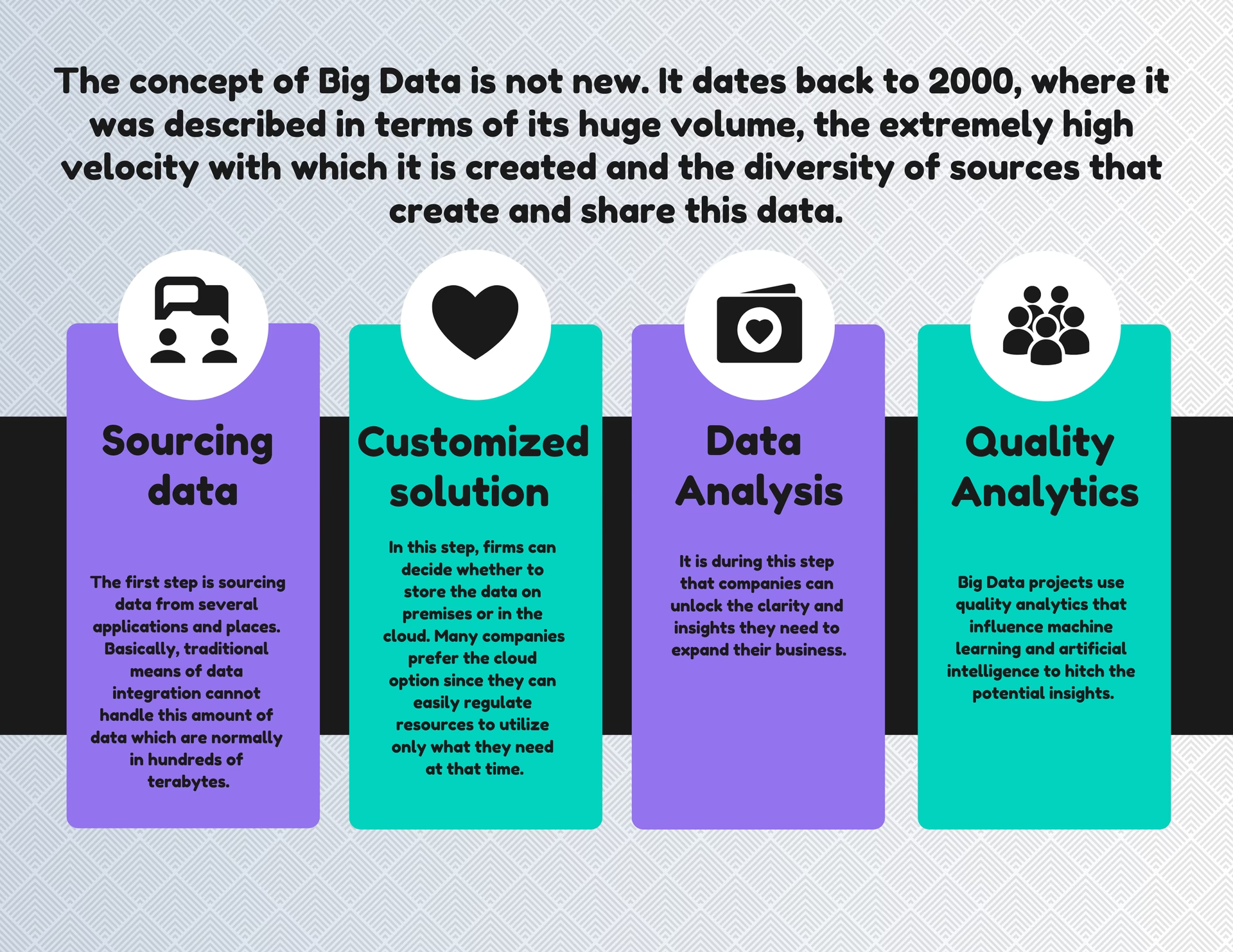

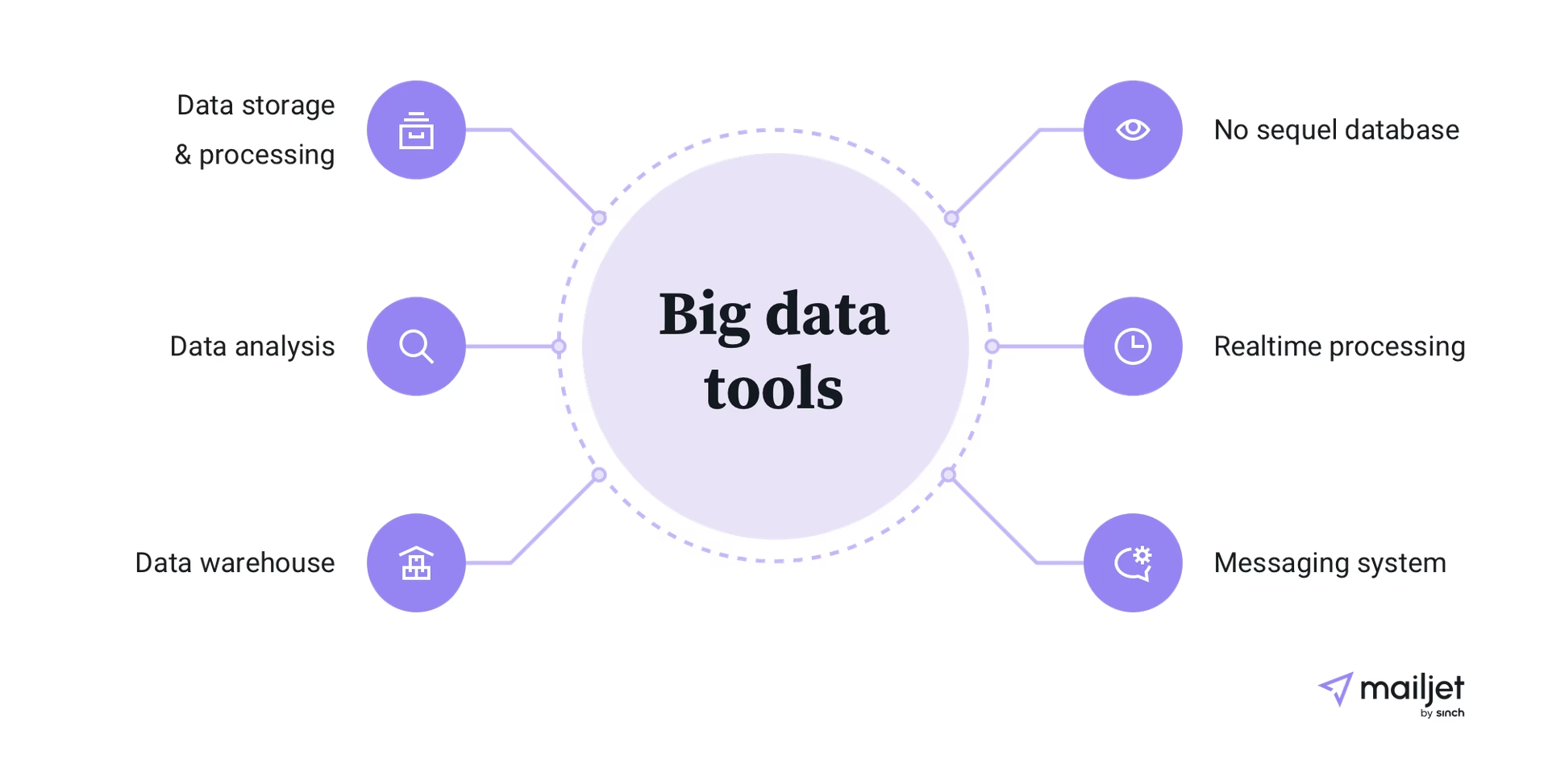

Opbygning af en Solid Big Data Strategi

For at udvikle en solid datastrategi er det først nødvendigt at forstå, hvad man ønsker at opnå, identificere konkrete use cases, og hvilke data der allerede er tilgængelige. Man skal også vurdere, hvilke yderligere data der måtte være nødvendige for at opfylde forretningsmæssige mål, og hvilke nye systemer eller værktøjer der kræves for at nå dem. I modsætning til traditionelle datastyringsløsninger er Big Data teknologier og værktøjer designet til at hjælpe med at håndtere store og komplekse datasæt for at udtrække værdi derfra.

Det er vigtigt at bemærke, at når det kommer til Big Data, findes der ikke én strategi, der passer til alle. Hvad der virker for én virksomhed, er måske ikke den rette strategi for din organisations specifikke behov.

Her er fire nøglekoncepter for at forme en effektiv Big Data strategi, baseret på erfaringer fra Google Cloud:

Åbenhed (Open)

Organisationer har brug for frihed til at bygge det, de ønsker, med de værktøjer og løsninger, de foretrækker. Efterhånden som datakilder vokser, og nye teknologiske innovationer dukker op, består virkeligheden af Big Data af flere grænseflader, open source teknologistakke og skyer. Big Data miljøer skal designes, så de er åbne og tilpasningsdygtige, så virksomheder kan skabe de løsninger og opnå de data, de har brug for til at levere gode resultater.

Intelligens (Smart)

Big Data kræver datafunktioner, der gør det muligt at udnytte intelligent analyse og AI- og Machine Learning-teknologier for at spare tid og kræfter, levere værdifuld indsigt, der forbedrer forretningsbeslutninger, og administrere den overordnede Big Data infrastruktur. Man bør overveje at automatisere processer eller muliggøre selvbetjeningsanalyse, så medarbejdere kan arbejde med data på egen hånd uden hjælp fra andre teams.

Fleksibilitet (Flexible)

Big Data analyse bør fremme innovation, ikke hæmme den. Dette kræver opbygning af en database, der tilbyder adgang on-demand til compute- og lagringsressourcer, og som samler data, så de let kan opdages og tilgås. Det er også vigtigt at kunne vælge teknologier og løsninger, der let kan kombineres og bruges til at skabe det perfekte sæt af data-værktøjer, der passer til arbejdsbyrden og use casen.

Tillid (Trusted)

For at Big Data skal være nyttigt, skal det være pålideligt. Derfor er det afgørende at opbygge tillid til dine data; dvs. at de er nøjagtige, relevante og beskyttede. Uanset hvor data stammer fra, skal de være sikre som standard, og strategien skal også tage højde for, hvilke sikkerhedsfunktioner der vil være nødvendige for at sikre compliance, redundans og pålidelighed.

Et eksempel på en teknologi, der understøtter en fleksibel Big Data strategi, er data lakes. Data lakes indsamler, behandler og gemmer struktureret, ustruktureret og semi-struktureret data i enhver skala i deres native format. Data lakes er grundlaget for at køre forskellige typer intelligent analyse, såsom visualiseringer, realtidsanalyse og machine learning.

Virkeligheden med Big Data Projekter: 80/20 Reglen

Hvor bruger dataforskere det meste af deres tid? Svaret overrasker måske. Pareto-princippet, også kendt som 80/20 reglen, gælder ofte for dataforskning:

Dataforskere bruger cirka 80% af deres værdifulde tid på at finde, rense og organisere data. Dette efterlader kun cirka 20% af deres tid til faktisk at udføre analyse på dataene – hvilket er den mest behagelige del af rollen for de fleste.

Dette problem forstærkes, efterhånden som datamængden stiger. Dataforskere bruger timer på at rense data og oprette rapporter, kun for at finde ud af, at de ledte efter noget andet, eller at de ikke forstod analysen godt nok til at handle på den.

Almindelige udfordringer i dataforberedelse:

- Mellemrum (white spaces)

- Null-værdier

- Ikke-identiske duplikater

- Uigenkendelige tegn

- Valuta- og enhedsomregninger

Med mere data tilgængeligt ser dataforskere flere problemer i det. Hvert datasæt kommer med et unikt sæt udfordringer, der skal løses, før man kan fortsætte med analysen. Derudover afhænger data-wrangling (processen med at omdanne og kortlægge data fra én 'rå' form til en anden form med det formål at gøre den mere passende og værdifuld for en række downstream-formål såsom analyse) i høj grad af:

- Hvilken datakilde der bruges

- Antallet af kilder

- Datamængden

- Selve opgaven

- Dataens art (fordeling, manglende værdier, osv.)

Desuden arbejder dataforskere med strenge deadlines, der kan kompromittere kvaliteten af arbejdet fra fremragende til 'godt nok'. Hvis et datasæt til et tidsfølsomt projekt tager længere tid end forventet at indsamle og rense, kan det være forældet, før analysen er færdig. Derfor er det vigtigt for organisationer at prioritere forretningsbehovene: hvad skal løses med det samme, og hvad kan vente.

Overvindelse af faldgruberne

Data forbedrer forretningsdriften og strukturen i en organisation. At have en central 'kilde til sandhed' er afgørende for dataforskere, da de også er ansvarlige for data governance, hvilket sikrer, at data er sikre og private. Dette hjælper ikke kun dataforskere med det, de har brug for; det accelererer analysen og giver dem tillid til at bruge ethvert givet datasæt uden at skulle stoppe op og sikre, at det er opdateret og rent.

Datakataloger er metadata management systemer og hjælper dataanalytikere med at finde de data, de har brug for, og giver den nødvendige information til at vurdere, om det er bæredygtigt at bruge. Der er en række fordele ved at udnytte datakataloger, herunder:

- Optimering af data governance

- Konsistens i datakvalitet

- Forbedring af dataeffektivitet

- Reduktion af risiko for fejl

Dataforskere spiller en essentiel rolle i organisationer ved at fremme innovation. Det vigtigste skridt er at gøre data tilgængelige for alle i organisationen og lette at bruge. Data, der ikke bruges eller ikke kan bruges, har ingen værdi. Med andre ord er det afgørende at skabe en datadreven kultur. Datadrevne organisationer anser data som et centralt forretningsaktiv, der er essentielt for forretningsvækst og succes – det er ikke bare noget, der er rart at have.

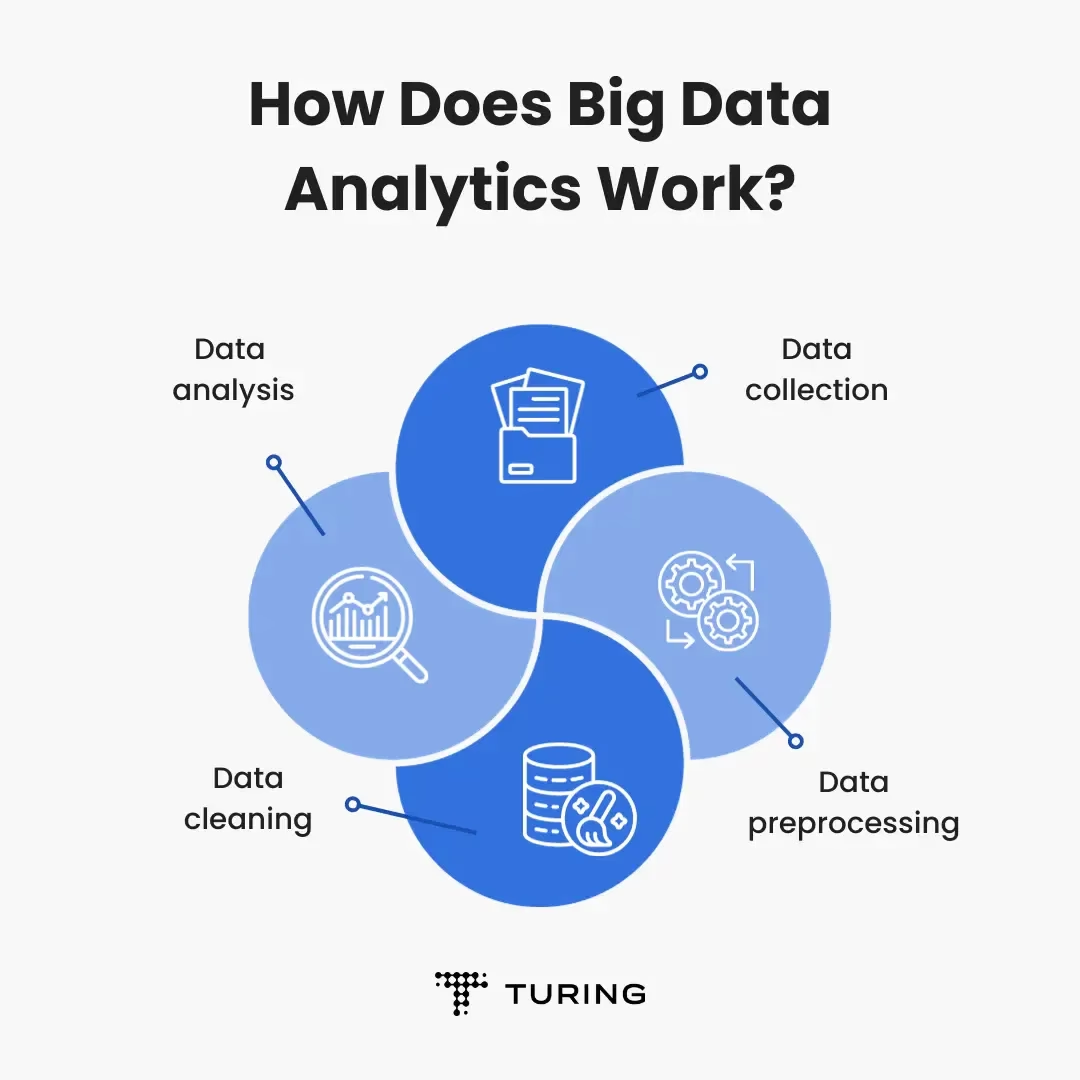

De Fire Typer af Big Data Analyse

Der er fire hovedtyper af Big Data analyse. Hver tjener et forskelligt formål og tilbyder varierende niveauer af indsigt. Tilsammen muliggør de for virksomheder at opnå en omfattende forståelse af deres Big Data og træffe beslutninger for at drive forbedret performance.

Beskrivende Analyse (Descriptive Analytics)

Denne type fokuserer på at opsummere historiske data for at fortælle, hvad der er sket i fortiden. Den bruger aggregering, data mining og visualiseringsteknikker til at forstå trends, mønstre og key performance indicators (KPI'er). Beskrivende analyse hjælper dig med at forstå din nuværende situation og træffe informerede beslutninger baseret på historisk information. Det svarer på spørgsmålet: 'Hvad skete der?'

Diagnostisk Analyse (Diagnostic Analytics)

Diagnostisk analyse går ud over at beskrive tidligere begivenheder og sigter mod at forstå, hvorfor de opstod. Den adskiller data for at identificere de grundlæggende årsager til specifikke udfald eller problemer. Ved at analysere relationer og korrelationer inden for dataene hjælper diagnostisk analyse dig med at få indsigt i faktorer, der påvirker dine resultater. Den svarer på spørgsmålet: 'Hvorfor skete det?'

Prædiktiv Analyse (Predictive Analytics)

Denne type analyse bruger historiske data og statistiske algoritmer til at forudsige fremtidige begivenheder. Den spotter mønstre og trends og forudsiger, hvad der sandsynligvis vil ske næste gang. Du kan bruge prædiktiv analyse til at forudse kundeadfærd, produktefterspørgsel, markedstrends og mere for proaktivt at planlægge og træffe strategiske beslutninger. Den svarer på spørgsmålet: 'Hvad vil ske?'

Præskriptiv Analyse (Prescriptive Analytics)

Præskriptiv analyse bygger på prædiktiv analyse ved at anbefale handlinger for at optimere fremtidige udfald. Den overvejer forskellige mulige handlinger og deres potentielle indvirkning på den forudsagte begivenhed eller udfald. Præskriptiv analyse hjælper dig med at træffe datadrevne beslutninger ved at foreslå den bedste handlingsplan baseret på dine ønskede mål og eventuelle begrænsninger. Den svarer på spørgsmålet: 'Hvad skal vi gøre?'

Sammenligning af Analysetyper

| Analysetype | Spørgsmål besvaret | Formål/Metode |

|---|---|---|

| Beskrivende | Hvad skete der? | Opsummerer historiske data; identificerer trends og mønstre (aggregering, mining, visualisering). |

| Diagnostisk | Hvorfor skete det? | Identificerer årsager til udfald; analyserer relationer og korrelationer. |

| Prædiktiv | Hvad vil ske? | Forudsiger fremtidige begivenheder baseret på historiske data og algoritmer. |

| Præskriptiv | Hvad skal vi gøre? | Anbefaler handlinger for at optimere udfald; bygger på prædiktiv analyse. |

Ofte Stillede Spørgsmål om Big Data

Hvad er de 5 V'er af Big Data?

De 5 V'er er Volume (mængden), Value (værdien), Variety (variationen af datatyper), Velocity (hastigheden af dataflow) og Veracity (dataens sandhed eller nøjagtighed). Nogle inkluderer også Variability (inkonsistens).

Hvorfor er data-rensning (cleaning) så vigtigt i Big Data projekter?

Data-rensning er afgørende, fordi Big Data ofte indeholder ufuldkommenheder som null-værdier, duplikater og uigenkendelige tegn. Dataforskere bruger omkring 80% af deres tid på denne opgave for at sikre, at data er nøjagtige og pålidelige til analyse, hvilket er nødvendigt for at udtrække reel værdi.

Hvad er et data lake, og hvilken rolle spiller det?

Et data lake er et system, der kan indsamle, behandle og gemme store mængder struktureret, ustruktureret og semi-struktureret data i deres native format. Det fungerer som et grundlag for forskellige typer intelligent analyse, såsom machine learning og realtidsanalyse, ved at give adgang til rå data i stor skala.

Hvad er forskellen mellem prædiktiv og præskriptiv analyse?

Prædiktiv analyse forudsiger, hvad der vil ske i fremtiden baseret på historiske data. Præskriptiv analyse går et skridt videre ved at anbefale de bedste handlinger, man skal tage for at opnå et ønsket fremtidigt udfald, baseret på forudsigelserne og forskellige overvejelser.

Hvad gør en Big Data strategi effektiv ifølge Google Cloud's erfaringer?

En effektiv strategi er Åben (tilpasningsdygtig og bruger forskellige værktøjer), Intelligent (udnytter AI/ML for indsigt og automatisering), Fleksibel (tilbyder on-demand adgang og forener data) og har Tillid (data er pålidelige, sikre og nøjagtige).

Hvad er formålet med et datakatalog?

Et datakatalog er et metadata management system, der hjælper dataanalytikere med at finde og evaluere data. Det bidrager til at optimere data governance, forbedre datakvalitet og effektivitet samt reducere risikoen for fejl ved at give en central, pålidelig kilde til information om tilgængelige data.

Samlet set kræver Big Data en omfattende tilgang, der adresserer ikke kun de tekniske udfordringer ved at håndtere store mængder, hastighed og variation, men også de strategiske og organisatoriske aspekter af at udtrække værdi og sikre dataens pålidelighed. En veldefineret strategi, der omfatter de rette værktøjer og en datadreven kultur, er nøglen til succes i Big Data æraen.

Kunne du lide 'Forstå Big Data: Elementer, Strategi & Analyse'? Så tag et kig på flere artikler i kategorien Læsning.